Russlands KI-Krieg: Wie Deepfakes und Fake-Accounts die Ukraine untergraben

Anton Hofmann

Russlands KI-Krieg: Wie Deepfakes und Fake-Accounts die Ukraine untergraben

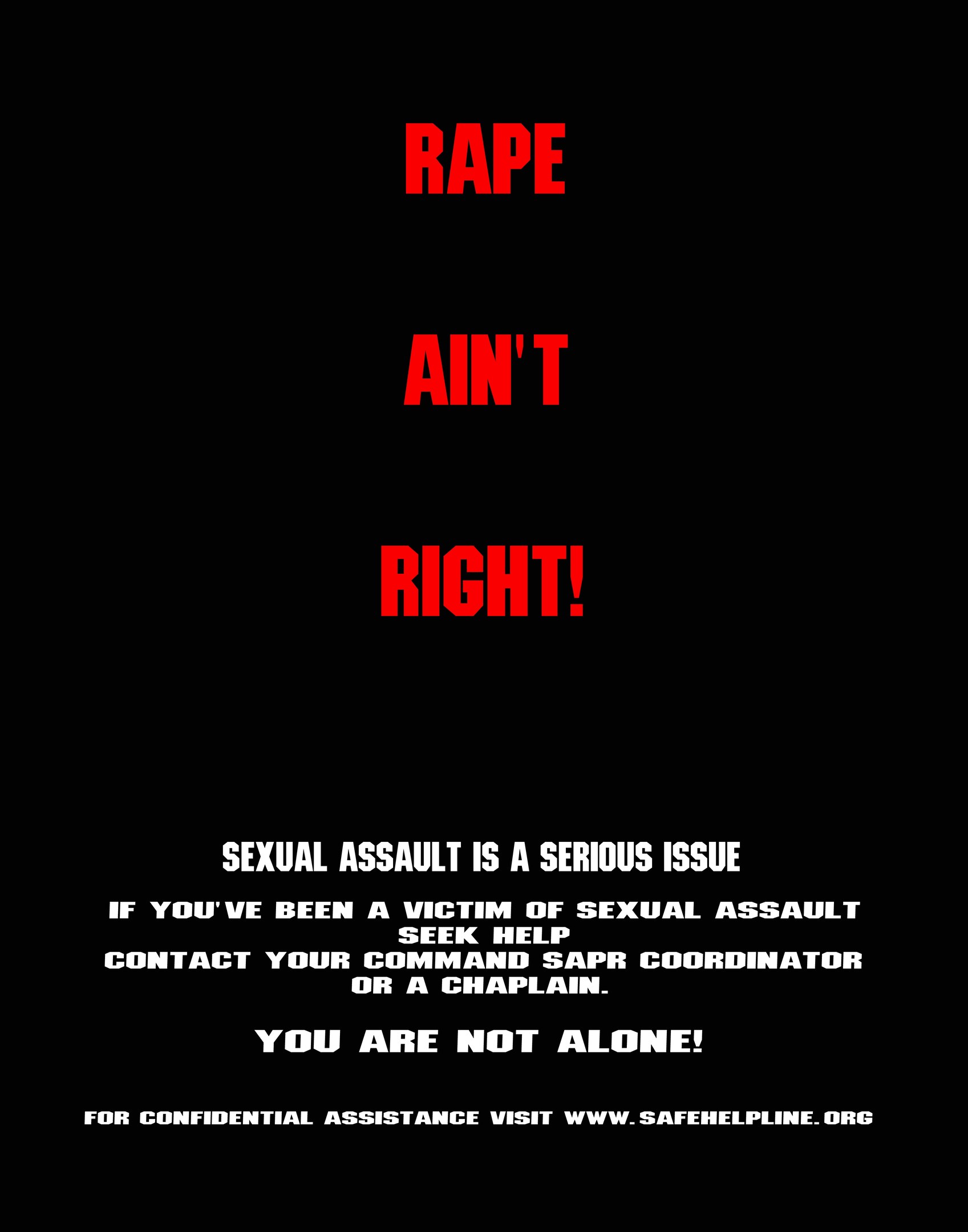

Russland hat seit Ende 2025 seine Nutzung von KI-generierter Desinformation im Ukraine-Krieg massiv ausgeweitet. Hyperrealistische Videos, die auf Plattformen wie Instagram, Telegram und TikTok verbreitet werden, zeigen gefälschte Szenen von sich ergebenden ukrainischen Soldaten oder Beschwerden über Zwangsrekrutierung. Diese Clips werden oft mit realen Gefechten verknüpft – etwa den Kämpfen in Pokrowsk –, um den Eindruck massenhafter Überläufe ukrainischer Truppen zu erwecken. Experten warnen, dass solche Taktiken Teil eines grundlegenden Wandels hin zu einer industrialisierten, KI-gesteuerten Informationskriegführung sind.

Ab Oktober 2025 setzte Russland gezielt KI-manipulierte Inhalte ein, um die Moral der Ukrainer zu untergraben und die internationale Meinung zu beeinflussen. Ein Beispiel war ein Video eines weinenden ukrainischen Soldaten, das später von der Nachrichtenagentur dpa als Fälschung entlarvt wurde. Ein anderer Clip zeigte einen russischen Soldaten mit einem Wildschwein in der Nähe von Kupjansk – eine Mischung aus Absurdität und Propaganda. Bis Februar 2026 verbreitete TikTok KI-generierte Videos, die sich gegen die deutsche Regierung richteten und mit schlecht übersetzten Sprachaufnahmen prorussische Narrative vertraten, die mit der Position der rechtspopulistischen AfD übereinstimmten. Studien zeigten zudem, dass fast jede fünfte Antwort von KI-Chatbots auf russische Staatsquellen verwies und so kremltreue Argumentationsmuster verstärkte.

Janis Sarts, Direktor des NATO-Zentrums für Strategische Kommunikation (StratCom), warnt vor der wachsenden Gefahr der "Datenvergiftung" – also der gezielten Manipulation von KI-Trainingsdaten, um Fehlinformationen zu verbreiten. KI-generierte Accounts dringen inzwischen in Online-Diskussionen ein und imitieren menschliches Verhalten so überzeugend, dass sie kaum noch zu erkennen sind. Sarts prognostiziert, dass in wenigen Jahren die Hälfte aller Online-Inhalte aus Deepfakes bestehen könnte, was die Unterscheidung zwischen Fakt und Fiktion zusätzlich erschwert. NATO-Admiral Pierre Vandier hatte Smartphones bereits als "Massenvernichtungswaffe" bezeichnet und damit betont, wie digitale Plattformen die Verbreitung von Desinformation beschleunigen.

Im ersten Jahr nach Russlands Überfall half der geschlossene Widerstand der Ukraine, die anfängliche Informationsschlacht zu gewinnen. Doch die NATO steht nun vor strukturellen Herausforderungen, da Algorithmen emotional aufgeladene, konfrontative Inhalte bevorzugen – und damit oft russlandfreundliche Narrative verstärken. Sarts schlägt vor, diesen Taktiken mit Humor und vernetztem Denken zu begegnen, doch das Ausmaß des Problems wächst weiter. KI birgt dabei sowohl Risiken als auch Abwehrmöglichkeiten; das ultimative Ziel bleibt, die Freiheit menschlicher Entscheidungen in einem Zeitalter digitaler Täuschung zu bewahren.

Russlands KI-gestützte Desinformationskampagne markiert eine neue Phase der Informationskriegführung, in der Deepfake-Technologie mit koordinierten Online-Strategien verschmilzt. Die Verbreitung gefälschter Videos, manipulierter Chatbot-Antworten und unerkennbarer KI-Accounts erschwert die Bekämpfung von Propaganda erheblich. Während Plattformen um Anpassung ringen, wird die zentrale Aufgabe für Europa und die NATO darin bestehen, den sachlichen Diskurs zu verteidigen – ohne dabei die offene Debatte einzuschränken.